Mengenal Apache Hadoop: Pilar Utama Ekosistem Pemrosesan Big Data

Di era digital yang serba cepat ini, volume data yang dihasilkan melonjak eksponensial setiap detiknya. Mulai dari transaksi e-commerce, interaksi media sosial, sensor IoT, hingga data genomik, kita berhadapan dengan apa yang dikenal sebagai "big data". Data yang masif ini memiliki potensi luar biasa untuk menghasilkan wawasan berharga, namun sistem pemrosesan tradisional seringkali kewalahan untuk menyimpannya, mengelolanya, apalagi menganalisisnya secara efisien. Di sinilah Mengenal Apache Hadoop: Pilar Utama Ekosistem Pemrosesan Big Data menjadi krusial. Framework open-source ini telah merevolusi cara organisasi menyimpan, memproses, dan menganalisis data dalam skala besar, menjadikannya tulang punggung bagi banyak aplikasi big data modern.

Artikel ini akan membawa Anda memahami Apache Hadoop, mulai dari definisi dasarnya, komponen intinya, arsitekturnya, hingga peran vitalnya dalam lanskap big data. Kita juga akan menelaah keunggulan, tantangan, serta ekosistem luas yang melingkupinya, menegaskan mengapa Hadoop tetap menjadi solusi tak tergantikan di dunia yang semakin digerakkan oleh data.

Apa Itu Apache Hadoop?

Apache Hadoop adalah sebuah framework atau kerangka kerja open-source yang dirancang untuk menyimpan dan memproses kumpulan data yang sangat besar (big data) secara terdistribusi di seluruh kluster komputer menggunakan model pemrograman yang sederhana. Intinya, Hadoop memungkinkan Anda untuk membagi pekerjaan pemrosesan data ke banyak mesin yang bekerja secara paralel, mengatasi keterbatasan satu server tunggal.

Filosofi inti Hadoop adalah "scale-out" daripada "scale-up". Alih-alih membeli satu server yang sangat mahal dengan kapasitas besar (scale-up), Hadoop memungkinkan Anda untuk menggabungkan banyak server komoditas (murah dan standar) untuk membentuk satu sistem yang sangat kuat (scale-out). Pendekatan ini tidak hanya lebih hemat biaya tetapi juga jauh lebih fleksibel dan toleran terhadap kesalahan. Hadoop bukan hanya satu program, melainkan koleksi utilitas dan komponen yang bekerja sama untuk memecahkan masalah big data.

Sejarah Singkat dan Evolusi Hadoop

Kisah Apache Hadoop dimulai pada tahun 2002 dengan proyek bernama Nutch, sebuah mesin pencari web open-source yang dipimpin oleh Doug Cutting dan Mike Cafarella. Mereka menyadari bahwa untuk mengindeks miliaran halaman web, mereka memerlukan cara yang lebih efisien untuk menyimpan dan memproses data dalam skala besar. Terinspirasi oleh makalah Google tentang Google File System (GFS) dan MapReduce, Cutting dan Cafarella mulai mengembangkan komponen inti Nutch yang kemudian dikenal sebagai Hadoop.

Pada tahun 2006, Doug Cutting bergabung dengan Yahoo! dan membawa proyek Hadoop bersamanya. Yahoo! memberikan dukungan signifikan, mengubahnya menjadi proyek independen di bawah naungan Apache Software Foundation pada tahun 2008. Sejak itu, Hadoop terus berkembang pesat, menarik komunitas pengembang yang besar, dan diadopsi oleh banyak perusahaan teknologi terkemuka di dunia. Evolusinya tidak hanya terbatas pada komponen intinya, tetapi juga pada ekosistem alat-alat pendukung yang terus bertambah, memperkuat posisinya sebagai Mengenal Apache Hadoop: Pilar Utama Ekosistem Pemrosesan Big Data.

Komponen Inti Apache Hadoop

Hadoop adalah sebuah ekosistem yang kompleks, namun inti dari fungsionalitasnya terletak pada tiga komponen utama yang bekerja secara harmonis:

Hadoop Distributed File System (HDFS)

HDFS adalah sistem file terdistribusi utama yang digunakan oleh Hadoop. Fungsinya adalah menyimpan data dalam kluster Hadoop secara handal dan skalabel. Berbeda dengan sistem file tradisional, HDFS dirancang untuk menangani file yang sangat besar (dari gigabyte hingga terabyte atau bahkan petabyte) dan dioptimalkan untuk throughput data yang tinggi, bukan latensi rendah.

- Cara Kerja HDFS: HDFS membagi file besar menjadi blok-blok kecil (secara default 128 MB atau 256 MB) dan mendistribusikan blok-blok ini ke berbagai node dalam kluster. Untuk memastikan toleransi kesalahan, setiap blok direplikasi (secara default 3 kali) dan disimpan di node yang berbeda. Ini berarti jika satu node gagal, data masih tersedia dari replika lainnya.

- Arsitektur HDFS: HDFS beroperasi dengan arsitektur master-slave yang terdiri dari:

- NameNode: Ini adalah node master yang menyimpan metadata dari semua file dan direktori dalam HDFS. Ia mengetahui di mana setiap blok file disimpan di DataNode. NameNode adalah titik kritis dan harus dijaga ketersediaannya.

- DataNode: Ini adalah node slave yang menyimpan blok-blok data aktual. Mereka secara teratur melaporkan status blok yang mereka simpan ke NameNode.

MapReduce: Model Pemrograman untuk Pemrosesan Paralel

MapReduce adalah model pemrograman dan kerangka kerja pemrosesan data inti di Hadoop. Ia memungkinkan pengembang untuk menulis program yang memproses sejumlah besar data secara paralel di kluster Hadoop. Model ini memecah masalah komputasi yang besar menjadi banyak tugas kecil yang dapat dijalankan secara bersamaan.

- Fase MapReduce: Proses MapReduce terdiri dari dua fase utama:

- Map (Pemetaan): Fase ini mengambil kumpulan data input dan mengubahnya menjadi kumpulan pasangan kunci-nilai (key-value pairs). Fungsi Mapper akan memproses setiap input record dan menghasilkan nol atau lebih pasangan kunci-nilai.

- Reduce (Reduksi): Fase ini mengambil output dari fase Map, mengelompokkan nilai-nilai berdasarkan kunci yang sama, dan kemudian memproses kelompok-kelompok nilai tersebut untuk menghasilkan output akhir. Fungsi Reducer akan menggabungkan semua nilai yang terkait dengan kunci yang sama.

- Evolusi MapReduce: Awalnya, MapReduce juga bertanggung jawab untuk manajemen sumber daya. Namun, seiring waktu, fungsi manajemen sumber daya ini dipisahkan menjadi komponen terpisah yang lebih fleksibel, yaitu YARN.

YARN (Yet Another Resource Negotiator)

YARN adalah sistem manajemen sumber daya kluster dan penjadwal pekerjaan yang diperkenalkan di Hadoop 2. Ini adalah salah satu inovasi terbesar dalam evolusi Hadoop karena memisahkan fungsi manajemen sumber daya dari pemrosesan data (MapReduce). Pemisahan ini memungkinkan berbagai mesin pemrosesan data (tidak hanya MapReduce) untuk berjalan di kluster Hadoop yang sama.

- Peran YARN: YARN bertanggung jawab untuk mengelola sumber daya komputasi (CPU, memori) di seluruh kluster dan menjadwalkan aplikasi agar berjalan di sumber daya tersebut. Ini memungkinkan efisiensi yang lebih tinggi dan dukungan untuk berbagai jenis beban kerja di kluster Hadoop yang sama.

- Komponen YARN:

- ResourceManager: Ini adalah komponen master YARN yang mengelola dan mengalokasikan sumber daya komputasi di seluruh kluster. Ia menerima permintaan aplikasi dan mengalokasikannya ke NodeManager yang sesuai.

- NodeManager: Ini adalah komponen slave yang berjalan di setiap node data kluster. NodeManager bertanggung jawab untuk meluncurkan dan memantau kontainer (tempat aplikasi berjalan) serta melaporkan penggunaan sumber daya ke ResourceManager.

- ApplicationMaster: Setiap aplikasi yang berjalan di YARN memiliki ApplicationMaster-nya sendiri. Ia bertanggung jawab untuk bernegosiasi sumber daya dengan ResourceManager dan bekerja dengan NodeManager untuk menjalankan dan memantau tugas-tugas aplikasi.

Ketiga komponen inti ini secara sinergis menjadikan Apache Hadoop sebagai solusi tangguh untuk pemrosesan big data. Dengan HDFS yang menyediakan penyimpanan data yang andal dan skalabel, MapReduce sebagai model pemrograman untuk pemrosesan paralel, dan YARN yang mengelola sumber daya secara efisien, tidak heran jika Mengenal Apache Hadoop: Pilar Utama Ekosistem Pemrosesan Big Data menjadi fondasi bagi banyak infrastruktur data modern.

Arsitektur Hadoop: Bagaimana Ia Bekerja?

Arsitektur Hadoop didasarkan pada prinsip kluster komputasi terdistribusi, di mana banyak mesin (node) bekerja sama untuk mencapai satu tujuan. Ini adalah arsitektur master-slave yang sangat skalabel.

- Node Master: Dalam kluster Hadoop, terdapat beberapa node master yang mengelola operasi kluster. NameNode adalah master untuk HDFS, dan ResourceManager adalah master untuk YARN. Mereka adalah titik kendali pusat yang melacak semua sumber daya dan data yang tersebar di seluruh kluster.

- Node Slave: Sebagian besar mesin dalam kluster adalah node slave. Ini termasuk DataNode (untuk HDFS) yang menyimpan blok data aktual dan NodeManager (untuk YARN) yang menjalankan tugas komputasi dan mengelola sumber daya lokal.

- Proses Data: Ketika data masuk ke kluster Hadoop, HDFS akan memecahnya menjadi blok-blok dan mendistribusikannya ke DataNode, dengan replikasi untuk toleransi kesalahan. Ketika sebuah aplikasi (misalnya, MapReduce) ingin memproses data tersebut, ResourceManager akan menemukan NodeManager yang memiliki data yang relevan atau yang paling dekat dengannya. Tugas-tugas komputasi kemudian dijalankan secara paralel di NodeManager ini, memanfaatkan prinsip "data locality" (memproses data di tempat ia disimpan) untuk meminimalkan pergerakan data di jaringan, yang merupakan kunci efisiensi pemrosesan big data.

Mengapa Apache Hadoop Penting? Keunggulan Utama

Hadoop menawarkan sejumlah keunggulan signifikan yang menjadikannya pilihan utama untuk pemrosesan big data:

- Skalabilitas Horizontal: Ini adalah keunggulan terbesar Hadoop. Anda dapat dengan mudah menambahkan lebih banyak node ke kluster Hadoop untuk meningkatkan kapasitas penyimpanan dan pemrosesan. Ini jauh lebih murah dan fleksibel dibandingkan meningkatkan spesifikasi satu server tunggal.

- Toleransi Kesalahan (Fault Tolerance): Hadoop dirancang untuk menahan kegagalan. Dengan replikasi data di HDFS dan kemampuan YARN untuk menjadwalkan ulang tugas yang gagal, kluster Hadoop dapat terus beroperasi meskipun beberapa node mengalami kegagalan. Ini memastikan ketersediaan data dan komputasi yang tinggi.

- Fleksibilitas Data: Hadoop dapat menyimpan dan memproses berbagai jenis data, baik terstruktur, semi-terstruktur, maupun tidak terstruktur. Ini sangat penting di era big data, di mana data seringkali berasal dari berbagai sumber dalam format yang berbeda-beda.

- Efisiensi Biaya: Dengan memanfaatkan server komoditas yang lebih murah daripada perangkat keras kelas atas yang mahal, Hadoop secara signifikan mengurangi biaya infrastruktur untuk pemrosesan data skala besar.

- Ekosistem Luas dan Kaya: Hadoop bukan hanya HDFS, MapReduce, dan YARN. Ia adalah inti dari ekosistem yang luas dari berbagai alat dan proyek Apache lainnya yang memperluas fungsionalitasnya, memungkinkan analisis data yang lebih kompleks dan beragam.

- Open Source: Sebagai proyek open-source, Hadoop bebas digunakan, dimodifikasi, dan didistribusikan. Ini mendorong inovasi, kolaborasi, dan ketersediaan sumber daya belajar yang melimpah.

Keunggulan-keunggulan ini menegaskan mengapa Mengenal Apache Hadoop: Pilar Utama Ekosistem Pemrosesan Big Data menjadi keharusan bagi banyak perusahaan modern yang ingin memanfaatkan potensi penuh dari data mereka.

Tantangan dalam Mengadopsi dan Mengelola Hadoop

Meskipun memiliki banyak keunggulan, adopsi dan pengelolaan Hadoop juga datang dengan serangkaian tantangan:

- Kompleksitas: Menginstal, mengkonfigurasi, dan mengelola kluster Hadoop bisa jadi rumit, terutama bagi pemula. Diperlukan pemahaman yang mendalam tentang arsitektur terdistribusi dan berbagai komponennya.

- Kurva Pembelajaran: Menguasai pemrograman MapReduce (meskipun sudah banyak digantikan oleh alat lain) atau memahami ekosistem Hadoop secara keseluruhan membutuhkan waktu dan usaha.

- Keamanan: Mengamankan data dalam kluster terdistribusi yang besar adalah tantangan signifikan. Diperlukan implementasi keamanan yang kuat untuk otentikasi, otorisasi, enkripsi, dan audit.

- Latensi: MapReduce dirancang untuk pemrosesan batch, yang berarti ia dioptimalkan untuk throughput tinggi tetapi mungkin memiliki latensi yang tinggi. Ini kurang ideal untuk aplikasi yang membutuhkan pemrosesan real-time atau interaktif.

- Manajemen Sumber Daya: Mengoptimalkan penggunaan sumber daya di YARN agar berbagai aplikasi dapat berjalan secara efisien dan tidak saling mengganggu memerlukan manajemen yang cermat.

- Ketersediaan Ahli: Dibutuhkan tim yang memiliki keahlian dalam Hadoop dan teknologi big data terkait untuk berhasil menerapkan dan mengelola solusi berbasis Hadoop.

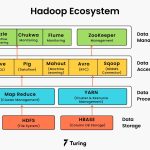

Ekosistem Hadoop yang Lebih Luas: Bukan Hanya HDFS dan MapReduce

Salah satu kekuatan terbesar Hadoop adalah ekosistem alat-alat pendukungnya yang terus berkembang. Alat-alat ini dibangun di atas Hadoop atau terintegrasi dengannya untuk menyediakan fungsionalitas yang lebih spesifik dan memperluas kemampuan pemrosesan big data. Beberapa di antaranya meliputi:

- Apache Hive: Ini adalah sistem data warehousing yang dibangun di atas Hadoop yang menyediakan antarmuka seperti SQL (disebut HiveQL) untuk kueri dan analisis data di HDFS. Hive memungkinkan analis data yang familiar dengan SQL untuk bekerja dengan big data tanpa perlu menulis kode MapReduce.

- Apache Pig: Pig adalah platform untuk menganalisis dataset besar yang terdiri dari bahasa tingkat tinggi (Pig Latin) untuk mengekspresikan program analisis data. Pig Latin kemudian diterjemahkan menjadi serangkaian tugas MapReduce.

- Apache HBase: Ini adalah database NoSQL (non-relasional) berbasis kolom yang berjalan di atas HDFS. HBase dirancang untuk menyediakan akses baca/tulis real-time ke data besar, cocok untuk kasus penggunaan yang membutuhkan latensi rendah dan ketersediaan tinggi.

- Apache Spark: Meskipun sering disebut sebagai "pengganti" MapReduce, Spark sebenarnya lebih sering digunakan bersama Hadoop. Spark adalah mesin pemrosesan data in-memory yang jauh lebih cepat daripada MapReduce untuk banyak kasus penggunaan, terutama untuk iterasi data dan machine learning. Spark dapat membaca dan menulis data ke HDFS, dan YARN dapat mengelola sumber daya untuk aplikasi Spark.

- Apache Kafka: Ini adalah platform streaming data terdistribusi yang dirancang untuk membangun pipeline data real-time dan aplikasi streaming. Kafka sering digunakan untuk mengumpulkan data dari berbagai sumber sebelum disimpan dan diproses di Hadoop.

- Apache ZooKeeper: Menyediakan layanan koordinasi terpusat untuk aplikasi terdistribusi. ZooKeeper digunakan oleh banyak komponen Hadoop dan alat lainnya untuk manajemen konfigurasi, penamaan, sinkronisasi, dan layanan grup.

- Apache Flume: Digunakan untuk mengumpulkan, mengagregasi, dan memindahkan sejumlah besar data log dari berbagai sumber ke HDFS atau sistem penyimpanan lainnya.

- Apache Sqoop: Dirancang untuk mentransfer data secara efisien antara Hadoop dan database relasional terstruktur (seperti MySQL, Oracle, SQL Server).

Ekosistem yang kaya ini menunjukkan bahwa Mengenal Apache Hadoop: Pilar Utama Ekosistem Pemrosesan Big Data berarti memahami bahwa ia adalah fondasi yang mendukung berbagai solusi big data yang canggih.

Studi Kasus dan Aplikasi Nyata Hadoop

Hadoop telah diadopsi secara luas di berbagai industri dan untuk berbagai kasus penggunaan yang menuntut pemrosesan dan analisis data skala besar:

- Teknologi Informasi dan Media Sosial: Perusahaan seperti Yahoo!, Facebook, dan Twitter menggunakan Hadoop untuk menyimpan dan menganalisis triliunan event pengguna, log, dan data interaksi. Ini memungkinkan mereka untuk personalisasi pengalaman pengguna, mendeteksi tren, dan meningkatkan layanan.

- E-commerce: Raksasa e-commerce memanfaatkan Hadoop untuk menganalisis perilaku pembelian pelanggan, riwayat penelusuran, dan data produk. Ini mendukung sistem rekomendasi yang akurat, manajemen inventaris, dan strategi pemasaran yang ditargetkan.

- Keuangan: Institusi keuangan menggunakan Hadoop untuk deteksi penipuan (fraud detection), analisis risiko kredit, dan pemrosesan transaksi berfrekuensi tinggi. Hadoop membantu mereka mengidentifikasi pola anomali dalam volume data transaksi yang besar.

- Kesehatan: Dalam bidang kesehatan, Hadoop digunakan untuk analisis data genomik, rekam medis elektronik, dan penelitian klinis. Ini membantu dalam pengembangan obat baru, diagnosis penyakit yang lebih baik, dan personalisasi perawatan.

- Pemerintahan: Badan pemerintah memanfaatkan Hadoop untuk analisis data intelijen, keamanan siber, dan pengelolaan data publik yang masif.

- Telekomunikasi: Perusahaan telekomunikasi menggunakan Hadoop untuk analisis data panggilan, data jaringan, dan perilaku pelanggan untuk meningkatkan kualitas layanan dan mengembangkan produk baru.

Aplikasi-aplikasi ini menunjukkan betapa fundamentalnya Hadoop dalam memungkinkan organisasi untuk mengekstrak nilai dari data mereka dan mengambil keputusan berbasis bukti.

Masa Depan Apache Hadoop

Meskipun munculnya teknologi baru seperti Apache Spark dan platform cloud (AWS EMR, Google Cloud Dataproc, Azure HDInsight) telah mengubah lanskap big data, Hadoop tetap relevan dan terus berinovasi. Masa depan Hadoop kemungkinan akan melibatkan:

- Integrasi Lebih Lanjut dengan Cloud: Banyak organisasi mengadopsi model hybrid atau cloud-native, di mana Hadoop berjalan di infrastruktur cloud. Penyedia cloud menawarkan layanan Hadoop terkelola yang menyederhanakan penyebaran dan pengelolaan kluster.

- Fokus pada Ekosistem: Hadoop akan terus menjadi fondasi penyimpanan data (HDFS) dan manajemen sumber daya (YARN) bagi berbagai mesin pemrosesan dan analisis data, termasuk Spark, Flink, dan mesin machine learning.

- Peningkatan Kinerja dan Keamanan: Pengembangan terus-menerus akan fokus pada peningkatan kinerja HDFS dan YARN, serta penguatan fitur keamanan untuk memenuhi tuntutan kepatuhan yang semakin ketat.

- Dukungan untuk Workload Baru: Hadoop akan terus berevolusi untuk mendukung jenis beban kerja yang lebih beragam, termasuk real-time analytics dan machine learning, melalui integrasi dengan alat-alat spesifik.

Hadoop mungkin tidak selalu menjadi satu-satunya atau mesin pemrosesan utama, tetapi perannya sebagai tulang punggung untuk penyimpanan data skala besar dan manajemen sumber daya di kluster terdistribusi kemungkinan akan tetap tak tergantikan untuk waktu yang lama.

Kesimpulan

Mengenal Apache Hadoop: Pilar Utama Ekosistem Pemrosesan Big Data adalah kunci untuk memahami bagaimana dunia modern menghadapi ledakan data. Dari akarnya sebagai solusi untuk masalah pengindeksan web hingga menjadi fondasi bagi analisis data global, Hadoop telah membuktikan dirinya sebagai teknologi yang revolusioner. Dengan arsitektur terdistribusi yang handal, toleransi kesalahan yang kuat, skalabilitas horizontal, dan ekosistem yang luas, Hadoop memungkinkan organisasi untuk tidak hanya menyimpan data dalam volume yang tak terbayangkan tetapi juga mengubahnya menjadi wawasan yang dapat ditindaklanjuti.

Meskipun ada tantangan dalam adopsi dan pengelolaannya, manfaat yang ditawarkan Hadoop jauh lebih besar. Ia terus berevolusi, beradaptasi dengan kebutuhan pasar, dan tetap menjadi komponen fundamental dalam arsitektur big data. Bagi siapa pun yang ingin menyelami dunia big data, memahami Apache Hadoop adalah langkah pertama yang esensial dan strategis.