Perbedaan Fundamental: Data Warehouse vs. Data Lake dalam Arsitektur Penyimpanan Data Skala Besar

Di era digital yang didominasi oleh ledakan informasi, pengelolaan dan analisis data telah menjadi tulang punggung setiap keputusan strategis bisnis. Perusahaan modern dihadapkan pada tantangan besar dalam menyimpan, memproses, dan mendapatkan wawasan dari volume data yang terus bertambah, baik yang terstruktur maupun tidak terstruktur. Untuk mengatasi tantangan ini, dua arsitektur penyimpanan data skala besar telah muncul sebagai solusi utama: Data Warehouse dan Data Lake.

Meskipun keduanya bertujuan untuk menyimpan data dan memfasilitasi analisis, perbedaan Data Warehouse dan Data Lake untuk penyimpanan data skala besar sangat mendasar dalam pendekatan, struktur, dan tujuan penggunaannya. Memahami perbedaan esensial ini krusial bagi organisasi untuk memilih platform yang tepat sesuai kebutuhan bisnis dan teknis mereka. Artikel ini akan mengupas tuntas kedua konsep ini, menyoroti karakteristik unik, kelebihan, kekurangan, serta skenario penggunaan ideal masing-masing.

Memahami Evolusi Penyimpanan Data Skala Besar

Perjalanan manajemen data telah berevolusi secara signifikan seiring dengan kemajuan teknologi dan pertumbuhan eksponensial volume data. Dari sistem basis data transaksional yang sederhana, kebutuhan akan analisis data yang lebih mendalam mendorong inovasi yang melahirkan solusi penyimpanan data yang lebih kompleks.

Era Awal: Kebutuhan akan Data Warehouse

Pada awalnya, perusahaan mengandalkan basis data operasional untuk transaksi harian. Namun, basis data ini tidak dirancang untuk analisis historis atau pelaporan yang kompleks, karena kueri analitis dapat memperlambat kinerja sistem operasional. Dari sinilah konsep Data Warehouse muncul pada akhir tahun 1980-an dan awal 1990-an, dipelopori oleh Bill Inmon.

Data Warehouse (Gudang Data) dirancang khusus untuk analisis dan pelaporan. Ia mengkonsolidasikan data dari berbagai sumber operasional ke dalam satu repositori yang terstruktur dan bersih, memungkinkan para eksekutif dan analis membuat keputusan bisnis yang lebih baik berdasarkan data historis yang konsisten.

Ledakan Data Tak Terstruktur: Munculnya Data Lake

Seiring waktu, jenis dan volume data yang dihasilkan perusahaan melampaui kemampuan Data Warehouse konvensional. Munculnya data tak terstruktur seperti log server, data sensor IoT, klik web, media sosial, dan data audio/video, serta kebutuhan akan analisis prediktif dan machine learning, menuntut pendekatan penyimpanan yang lebih fleksibel. Inilah latar belakang munculnya Data Lake (Danau Data) sekitar tahun 2010-an, didorong oleh teknologi big data seperti Hadoop.

Data Lake menawarkan solusi untuk menyimpan semua jenis data dalam format aslinya, tanpa skema yang telah ditentukan sebelumnya. Ini memberikan fleksibilitas tak terbatas untuk eksplorasi data dan mendukung berbagai jenis analisis canggih yang tidak mungkin dilakukan dengan Data Warehouse tradisional.

Data Warehouse: Gudang Data yang Terstruktur dan Terukur

Data Warehouse adalah repositori sentral data yang terintegrasi dari berbagai sumber yang berbeda. Data di dalamnya sudah diubah, dibersihkan, dan distrukturkan untuk tujuan analisis dan pelaporan bisnis.

Definisi dan Karakteristik

Karakteristik utama Data Warehouse dapat diringkas sebagai berikut:

- Berorientasi Subjek: Data diatur di sekitar subjek utama bisnis (misalnya, pelanggan, produk, penjualan) daripada proses operasional.

- Terintegrasi: Data dikumpulkan dari berbagai sumber yang berbeda dan disatukan ke dalam format yang konsisten.

- Tidak Volatil: Setelah data dimasukkan ke dalam Data Warehouse, data tersebut tidak berubah atau dihapus. Ini penting untuk analisis historis yang akurat.

- Berbasis Waktu: Semua data di dalam Data Warehouse dikaitkan dengan periode waktu tertentu, memungkinkan analisis tren dan perbandingan historis.

Data yang masuk ke Data Warehouse melalui proses Extract, Transform, Load (ETL). Dalam proses ini, data diekstrak dari sumber, ditransformasi menjadi format yang bersih dan konsisten sesuai skema yang telah ditentukan, kemudian dimuat ke dalam gudang data. Oleh karena itu, Data Warehouse menggunakan pendekatan schema-on-write, di mana skema data didefinisikan secara ketat sebelum data disimpan.

Kelebihan Data Warehouse

Penggunaan Data Warehouse menawarkan sejumlah keuntungan signifikan:

- Kualitas Data Tinggi: Proses ETL yang ketat memastikan data yang disimpan bersih, konsisten, dan akurat, mengurangi risiko kesalahan dalam analisis.

- Performa Query Cepat: Struktur data yang teroptimasi (seringkali menggunakan skema bintang atau kepingan salju) dirancang untuk kueri analitis yang kompleks, menghasilkan waktu respons yang cepat untuk laporan dan dashboard BI.

- Tata Kelola Data yang Kuat: Dengan skema yang jelas dan proses yang terdefinisi, tata kelola data, keamanan, dan kepatuhan lebih mudah diterapkan dan dipelihara.

- Mendukung Keputusan Bisnis: Menyediakan pandangan holistik dan historis tentang kinerja bisnis, memungkinkan eksekutif dan manajer membuat keputusan yang informasional dan strategis.

- Mudah Digunakan: Alat Business Intelligence (BI) modern terintegrasi dengan baik dengan Data Warehouse, memungkinkan pengguna bisnis non-teknis untuk membuat laporan dan analisis sendiri.

Kekurangan Data Warehouse

Meskipun kuat, Data Warehouse juga memiliki keterbatasan:

- Kurang Fleksibel untuk Data Mentah: Data Warehouse tidak ideal untuk menyimpan data mentah atau tidak terstruktur, karena memerlukan transformasi ekstensif sebelum dapat disimpan.

- Biaya Tinggi: Implementasi dan pemeliharaan Data Warehouse bisa sangat mahal, meliputi biaya perangkat keras, perangkat lunak, lisensi, dan keahlian sumber daya manusia.

- Skalabilitas Terbatas: Meskipun modern Data Warehouse berbasis cloud menawarkan skalabilitas yang lebih baik, skalabilitas horizontal untuk volume data ekstrem masih menjadi tantangan dibandingkan dengan Data Lake.

- Waktu Implementasi Lebih Lama: Proses desain skema dan ETL yang kompleks membutuhkan waktu dan upaya yang signifikan, memperpanjang siklus pengembangan.

- Kaku terhadap Perubahan: Perubahan pada skema atau penambahan sumber data baru dapat menjadi proses yang rumit dan memakan waktu.

Data Lake: Danau Data Mentah yang Luas dan Fleksibel

Berbeda dengan Data Warehouse, Data Lake adalah repositori data yang menyimpan data mentah dalam format aslinya. Ia dirancang untuk menyimpan semua jenis data dalam skala besar, baik terstruktur, semi-terstruktur, maupun tidak terstruktur.

Definisi dan Karakteristik

Karakteristik inti Data Lake meliputi:

- Penyimpanan Data Mentah: Data disimpan dalam format aslinya, tanpa transformasi atau pembersihan awal yang ekstensif.

- Fleksibilitas Skema: Mengadopsi pendekatan schema-on-read, di mana skema data diterapkan saat data dibaca atau dianalisis, bukan saat disimpan.

- Beragam Jenis Data: Mampu menampung data dari berbagai sumber dan format, termasuk database relasional, log, file XML, JSON, data sensor, gambar, video, dan audio.

- Biaya Penyimpanan Rendah: Seringkali dibangun di atas sistem file terdistribusi seperti Hadoop Distributed File System (HDFS) atau object storage berbasis cloud (seperti Amazon S3, Azure Data Lake Storage), yang menawarkan biaya penyimpanan per gigabyte yang jauh lebih rendah.

Proses data di Data Lake seringkali mengikuti paradigma Extract, Load, Transform (ELT). Data diekstrak dari sumber, dimuat langsung ke Data Lake dalam format mentahnya, kemudian ditransformasi sesuai kebutuhan saat analisis dilakukan.

Kelebihan Data Lake

Keunggulan utama Data Lake meliputi:

- Fleksibilitas Tinggi: Mampu menyimpan data dari sumber manapun, dalam format apapun, memberikan kebebasan tak terbatas untuk eksplorasi dan analisis.

- Biaya Penyimpanan Rendah: Solusi penyimpanan yang hemat biaya, terutama untuk volume data yang sangat besar.

- Skalabilitas Horizontal Tak Terbatas: Dirancang untuk menangani petabyte bahkan exabyte data dengan mudah, menjadikannya ideal untuk pertumbuhan data yang eksplosif.

- Mendukung Analisis Tingkat Lanjut: Platform ideal untuk machine learning (ML), kecerdasan buatan (AI), analisis prediktif, dan analisis preskriptif, karena menyediakan akses ke data mentah yang diperlukan untuk melatih model.

- Agility dalam Pengembangan: Karena tidak ada skema yang harus didefinisikan di awal, tim data dapat memulai eksperimen dan analisis lebih cepat.

Kekurangan Data Lake

Meskipun sangat fleksibel, Data Lake juga memiliki tantangan:

- Potensi "Data Swamp": Tanpa tata kelola yang tepat, Data Lake dapat dengan cepat berubah menjadi "rawa data" yang tidak terorganisir, di mana data sulit ditemukan, dipahami, atau digunakan.

- Kualitas Data Bervariasi: Karena menyimpan data mentah, kualitas data tidak dijamin. Analis perlu melakukan pembersihan dan transformasi data sendiri, yang bisa memakan waktu.

- Membutuhkan Keahlian Teknis Tinggi: Mengelola dan menganalisis data di Data Lake memerlukan keahlian teknis yang lebih tinggi, seperti pengetahuan tentang Hadoop, Spark, Python, R, dan alat big data lainnya.

- Keamanan dan Kepatuhan Kompleks: Menerapkan keamanan dan kepatuhan di Data Lake bisa lebih kompleks karena keragaman data dan kurangnya struktur bawaan.

- Performa Query: Kueri interaktif untuk pelaporan bisnis mungkin tidak secepat Data Warehouse yang teroptimasi, terutama untuk data yang belum diproses.

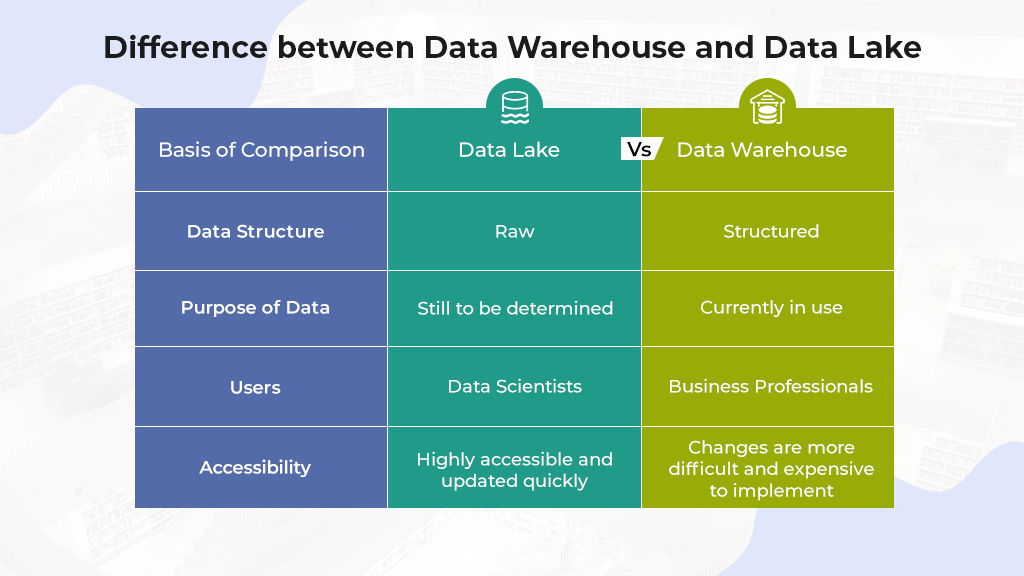

Perbedaan Data Warehouse dan Data Lake untuk Penyimpanan Data Skala Besar: Perbandingan Komprehensif

Untuk lebih memahami perbedaan Data Warehouse dan Data Lake untuk penyimpanan data skala besar, mari kita bandingkan keduanya berdasarkan beberapa aspek kunci:

Pendekatan Skema (Schema Approach)

- Data Warehouse: Menggunakan schema-on-write. Skema data didefinisikan secara ketat sebelum data dimuat. Ini memastikan konsistensi dan integritas data, tetapi membuatnya kurang fleksibel.

- Data Lake: Menggunakan schema-on-read. Data disimpan dalam format aslinya, dan skema diterapkan saat data dibaca atau dianalisis. Ini menawarkan fleksibilitas tinggi namun memerlukan upaya ekstra dari analis untuk memahami struktur data.

Jenis Data yang Disimpan

- Data Warehouse: Terutama menyimpan data terstruktur dan semi-terstruktur yang sudah dibersihkan, divalidasi, dan ditransformasi. Ideal untuk data transaksional dan historis.

- Data Lake: Mampu menyimpan semua jenis data—terstruktur, semi-terstruktur, dan tidak terstruktur—dalam format mentahnya. Ini termasuk log, data sensor, media sosial, video, audio, dan lain-lain.

Tujuan Utama dan Pengguna

- Data Warehouse: Dirancang untuk pelaporan bisnis, Business Intelligence (BI), dan analisis terprediksi. Pengguna utamanya adalah eksekutif, manajer, dan analis bisnis yang membutuhkan laporan yang konsisten dan akurat.

- Data Lake: Ditujukan untuk eksplorasi data, analisis tingkat lanjut, machine learning, dan kecerdasan buatan. Pengguna utamanya adalah ilmuwan data (data scientist), insinyur data (data engineer), dan pengembang aplikasi yang membutuhkan akses ke data mentah untuk menemukan pola baru.

Proses Data (ETL vs. ELT)

- Data Warehouse: Mengikuti paradigma ETL (Extract, Transform, Load). Data diubah dan dibersihkan sebelum dimuat ke gudang data.

- Data Lake: Mengikuti paradigma ELT (Extract, Load, Transform). Data dimuat ke danau data dalam format aslinya, kemudian ditransformasi sesuai kebutuhan saat analisis dilakukan.

Biaya dan Skalabilitas

- Data Warehouse: Cenderung lebih mahal per gigabyte, terutama untuk solusi on-premise atau platform berlisensi. Skalabilitasnya lebih vertikal atau terbatas, meskipun solusi cloud telah meningkatkan fleksibilitas ini.

- Data Lake: Jauh lebih hemat biaya per gigabyte, terutama saat menggunakan object storage atau HDFS. Menawarkan skalabilitas horizontal yang hampir tak terbatas, ideal untuk volume data yang sangat besar dan terus berkembang.

Kualitas dan Tata Kelola Data

- Data Warehouse: Memiliki kualitas data yang tinggi dan tata kelola yang ketat karena proses transformasi dan validasi yang ekstensif. Ini meminimalkan risiko "data swamp".

- Data Lake: Kualitas data bervariasi karena menyimpan data mentah. Tata kelola data harus proaktif dan terencana dengan baik untuk mencegah Data Lake berubah menjadi "data swamp" yang tidak dapat digunakan.

Performa dan Latensi

- Data Warehouse: Dioptimalkan untuk kueri analitis OLAP (Online Analytical Processing) yang cepat, cocok untuk pelaporan real-time atau mendekati real-time.

- Data Lake: Performa kueri bisa bervariasi tergantung pada alat yang digunakan dan seberapa jauh data telah diproses. Lebih cocok untuk pemrosesan batch besar dan analisis eksplorasi yang tidak selalu membutuhkan latensi rendah.

Kapan Menggunakan Data Warehouse, Kapan Menggunakan Data Lake?

Memilih antara Data Warehouse dan Data Lake bukanlah keputusan "satu ukuran untuk semua". Pilihan terbaik tergantung pada kebutuhan spesifik organisasi, jenis data, tujuan analisis, anggaran, dan keahlian tim.

Skenario Ideal untuk Data Warehouse

- Pelaporan Bisnis Reguler: Jika organisasi membutuhkan laporan keuangan bulanan, dashboard penjualan harian, atau metrik kinerja yang konsisten.

- Analisis Terprediksi: Untuk analisis yang membutuhkan data yang bersih, terstruktur, dan historis yang dapat diandalkan untuk memprediksi tren masa depan.

- Kebutuhan Konsistensi Data Tinggi: Ketika akurasi dan konsistensi data sangat penting, seperti dalam industri yang diatur ketat (keuangan, kesehatan).

- Pengguna Non-Teknis: Ketika pengguna bisnis perlu dengan mudah mengakses dan menganalisis data menggunakan alat BI tanpa perlu keahlian teknis mendalam.

Skenario Ideal untuk Data Lake

- Data Bervolume Tinggi dan Beragam: Untuk organisasi yang mengumpulkan data IoT, log server, data klik web, media sosial, atau data streaming yang bervolume besar dan dalam berbagai format.

- Eksplorasi Data dan Penemuan Insight Baru: Ketika tujuannya adalah untuk menemukan pola tersembunyi, melakukan eksperimen, atau mengembangkan model machine learning dari data mentah.

- Skema Data yang Belum Pasti: Jika skema data terus berubah atau belum dapat didefinisikan di awal.

- Analisis Prediktif dan Preskriptif: Untuk membangun aplikasi AI/ML yang membutuhkan akses ke data mentah dalam skala besar.

- Biaya Penyimpanan Efisien: Ketika volume data sangat besar dan biaya penyimpanan menjadi pertimbangan utama.

Konvergensi: Data Lakehouse sebagai Solusi Hibrida

Melihat kelebihan dan kekurangan masing-masing, banyak organisasi mulai mencari solusi yang menggabungkan yang terbaik dari kedua dunia. Konsep Data Lakehouse muncul sebagai arsitektur baru yang menjanjikan. Lakehouse berupaya menggabungkan skalabilitas, fleksibilitas, dan biaya rendah dari Data Lake dengan struktur, tata kelola, dan kemampuan performa Data Warehouse.

Dengan Lakehouse, data disimpan dalam format terbuka di Data Lake, namun lapisan metadata dan kemampuan tata kelola yang kaya ditambahkan di atasnya. Ini memungkinkan organisasi untuk melakukan kueri SQL berkinerja tinggi, menerapkan skema dan kontrol kualitas data, serta mendukung aplikasi BI tradisional, sambil tetap memanfaatkan data mentah untuk machine learning dan analisis tingkat lanjut.

Kesimpulan

Perbedaan Data Warehouse dan Data Lake untuk penyimpanan data skala besar sangatlah signifikan, masing-masing dengan kekuatan dan kelemahan yang unik. Data Warehouse menawarkan struktur, konsistensi, dan performa tinggi untuk pelaporan bisnis yang terprediksi, sementara Data Lake menyediakan fleksibilitas tak terbatas, skalabilitas, dan biaya rendah untuk eksplorasi data mentah dan analisis tingkat lanjut seperti machine learning.

Tidak ada solusi tunggal yang unggul secara universal. Pilihan terbaik bagi suatu organisasi akan sangat bergantung pada jenis data yang mereka miliki, tujuan analisis yang ingin dicapai, anggaran yang tersedia, dan tingkat keahlian tim data. Seiring dengan evolusi lanskap data, arsitektur hibrida seperti Data Lakehouse semakin populer, menawarkan jalan tengah yang menjanjikan untuk memanfaatkan keunggulan kedua pendekatan ini secara bersamaan. Memahami nuansa ini adalah langkah pertama menuju membangun strategi manajemen data yang efektif dan efisien di era big data.